Pousser un site web dans les tréfonds ou le hisser au sommet des résultats de recherche ne tient pas au hasard. Chaque audit SEO que j’effectue le confirme : c’est la précision des réglages, la cohérence des ajustements et le regard critique sur chaque page qui font la différence. Qu’est-ce qu’un audit SEO, pourquoi en réaliser un, et surtout, comment s’y prendre concrètement pour révéler le vrai potentiel de votre site ? Voici le guide terrain, pensé pour les indépendants, les agences et tous ceux qui veulent prendre le contrôle de leur visibilité.

Qu’est-ce qu’un audit SEO ?

Un audit SEO, c’est une analyse fouillée du site afin de mesurer son degré d’optimisation, tant sur le plan technique qu’éditorial. Il ne s’arrête pas à la façade : tout y passe, de la construction des pages aux performances en passant par la qualité des liens. L’expert SEO se fonde sur des checklists, ses outils favoris et surtout, un œil aiguisé pour traquer chaque détail qui coince. Chacun peut s’initier à cet exercice, à condition de s’accorder le temps nécessaire pour gratter chaque aspect.

Ce travail débouche sur un plan d’action. Ce dernier formalise les points de blocage, mais aussi les priorités pour aller plus loin dans les résultats de recherche. En clair, un audit SEO, c’est la base solide d’une stratégie de visibilité efficace pour les prochains mois.

À quoi sert un audit SEO ?

Son intérêt majeur : déterminer à quel point votre site colle ou non aux attentes des moteurs de recherche. À la clé, une feuille de route claire, orientée résultats. Selon le contexte, l’audit permet notamment de :

- Évaluer les performances globales du site (trafic, état du SEO actuel, etc.)

- Vérifier la qualité du travail réalisé par une équipe ou une agence externe

- Faire grimper la visibilité sur Google et les autres moteurs

Pour une agence, cet outil sert aussi à :

- Proposer de nouveaux services ou formules SEO

- Appuyer ses recommandations techniques auprès du client

- Donner une vision factuelle de la situation d’un prospect

Le véritable atout ? Les actions préconisées lors d’un audit SEO peuvent être mises en œuvre indifféremment par l’agence, le client lui-même, ou directement par le propriétaire du site. C’est un levier partagé.

Pourquoi un audit SEO a-t-il un coût ?

C’est la somme du temps investi et du niveau de détail qui explose la facture. Chaque page du site doit passer sous le microscope, selon des critères pointus mêlant technique, contenu, liens, et plus encore. Un gros site mobilise souvent plusieurs jours de travail, voire un calendrier de plusieurs semaines quand la structure est complexe. Les éditeurs spécialisés, payants eux aussi, font souvent partie du processus. S’y ajoutent l’expérience et la compétence de profils chevronnés. L’audit SEO reste un véritable investissement, mais aucun autre exercice ne vous dévoilera aussi franchement les freins à la progression en ligne.

Comment réaliser soi-même un audit SEO ?

Aborder l’audit SEO de façon autonome est tout à fait possible, à condition de suivre l’actualité sur le référencement, car le paysage change vite. Certes, l’expertise fait la différence, mais la persévérance, la curiosité et de solides réflexes d’adaptation permettent déjà d’avancer.

Google modifie chaque année des milliers de paramètres dans ses critères, bouleversant parfois subtilement le jeu. Les références d’hier peuvent devenir obsolètes très rapidement. Pour progresser pas à pas dans un audit SEO maison, trois leviers restent incontournables :

- Être en veille sur les changements en référencement et les tendances fortes

- Approfondir régulièrement ses connaissances en optimisation de site

- Tester sur le terrain, car c’est l’expérience concrète qui fait progresser

En guise de point de départ, certains guides détaillent très bien la démarche à adopter étape par étape. Ce qui vient après vous donnera les clés pour trouver et corriger les failles majeures de votre site.

Les outils pour réussir son audit SEO

Quelques outils deviennent vite irremplaçables : Google Analytics, Search Console, et si possible, la fiche Google My Business pour ceux concernés. Pour un regard poussé, les logiciels professionnels spécialisés sont redoutables. Voici ceux qui sont le plus couramment utilisés :

- Semrush

- Ahrefs

- Sistrix

- Screaming Frog Spider

Le logiciel Screaming Frog Spider analyse en profondeur jusqu’à 500 pages gratuitement, ce qui convient parfaitement à un petit site, à condition d’être prêt à manipuler des rapports riches en données.

Pour un audit gratuit, d’autres solutions existent :

- Audit de site Neil Patel

- Copyscape

L’outil de Neil Patel offre parfois des recommandations éclairantes, même si un outil payant reste bien plus complet.

Étape 1 : contrôler l’accessibilité SSL du site

Avant toute chose, vérifiez que votre site s’affiche sous une seule et même version. Différentes variations d’URL sont souvent accessibles :

- http://musterseite.de

- http://www.musterseite.de

- https://musterseite.de

- https://www.musterseite.de

Testez chaque adresse dans votre navigateur. Elles doivent toutes rediriger vers une seule version, idéalement sécurisée en HTTPS. Si ce n’est pas le cas ou si un avertissement “Non sécurisé” apparaît, le contact avec votre hébergeur ou webmaster devient indispensable pour activer correctement le certificat SSL ou actualiser la configuration DNS.

Sur certains hébergeurs spécialisés, l’activation est ultra-simple, un bouton suffit. Quoi qu’il en soit, HTTPS n’est pas qu’une simple formalité : Google en fait un critère de classement et vos visiteurs s’attendent à naviguer sur un site sûr. Pensez aussi à contrôler que toutes les ressources (images, scripts) sont chargées en HTTPS pour éviter les erreurs de contenu mixte. Le mode développeur de votre navigateur vous aidera à trouver les fichiers récalcitrants. Pour les utilisateurs de WordPress, un plugin comme Really Simple SSL règle souvent le problème.

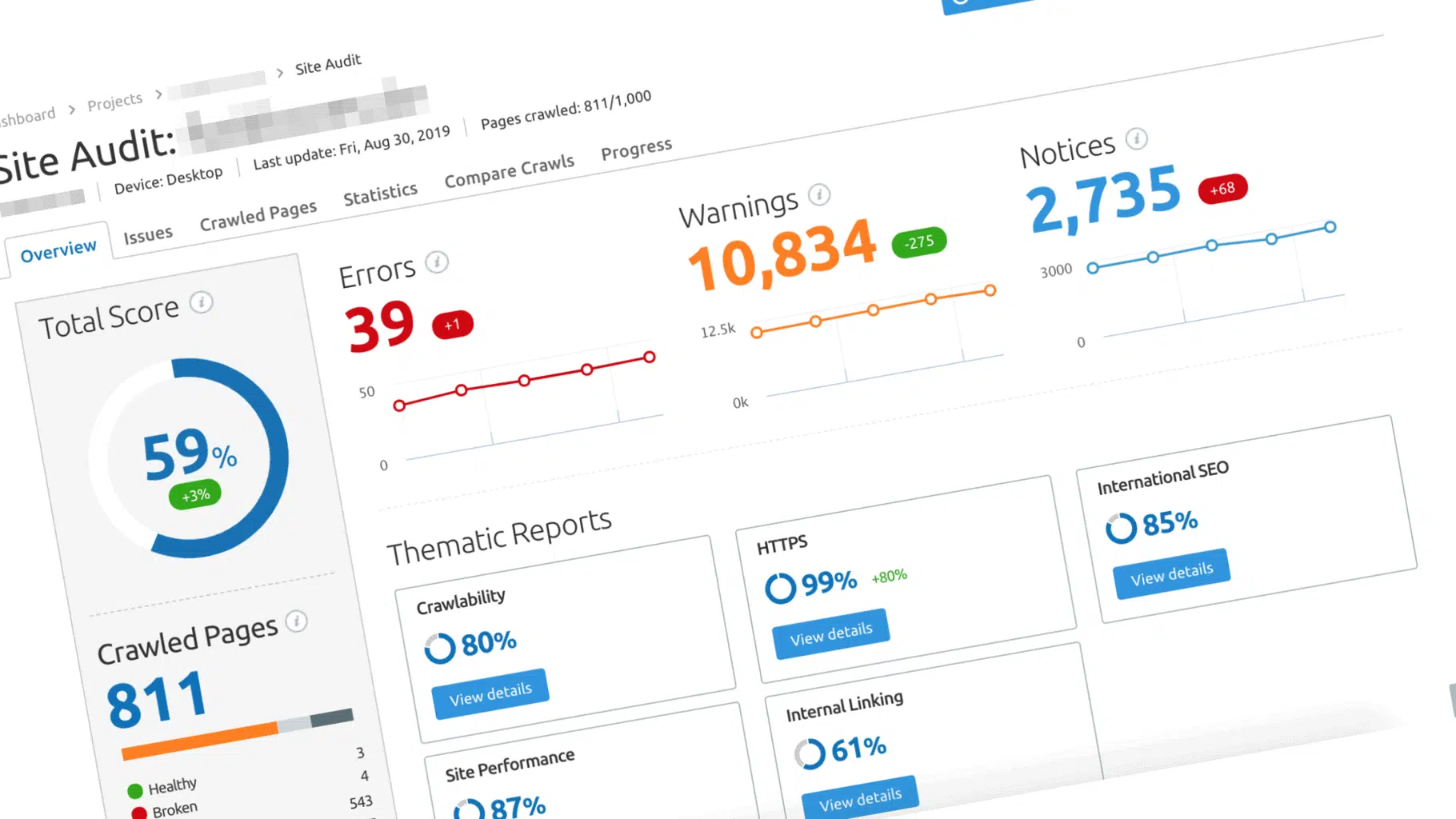

Étape 2 : passer à l’audit avec un outil SEO

Lancez un audit en utilisant le logiciel ou l’outil de votre choix. Les solutions simples affichent en quelques minutes les premiers axes d’amélioration, mais une version premium (même en essai) vous livrera des analyses beaucoup plus poussées. Pendant l’exploration, pensez à :

- Tenir compte des règles du fichier robots.txt (pour mimer un robot d’indexation)

- Explorer le site grâce au sitemap.xml (disponible à l’adresse domain.de/sitemap.xml ou domain.de/sitemap_index.xml)

En fonction de la taille du site, le relevé d’audit demande une part variable de patience, mais les principales pistes d’optimisation se dessinent très vite.

Étape 3 : indexation et nettoyage des erreurs

Votre site apparaît-il partout dans Google ?

Pour cela, tapez site:votredomaine.fr dans la barre de recherche Google. Vous verrez toutes les pages indexées de votre site. Si le chiffre semble cohérent, continuez. À défaut, approfondissez.

Ce que dit la Search Console

La Search Console recense tout ce qui se passe sur le plan de l’indexation. Assurez-vous que votre domaine y est bien renseigné, et que la bonne version (www ou non, HTTP ou HTTPS) correspond à votre configuration. Consultez la section « Couverture » pour débusquer les erreurs et les pages exclues. Passez en revue celles qui posent problème, corrigez, puis relancez l’analyse.

Un grand écart entre le total de pages indexées dans Google et celui de la Search Console révèle parfois la présence de pages 404 ou d’autres pages inutiles. Pour vérifier :

- Lancez à nouveau site:votredomaine.fr dans Google, cliquez sur quelques résultats et repérez d’éventuelles erreurs (notamment les 404)

- Lancez un crawl dans Screaming Frog pour arpenter toutes les pages et dénicher celles qui déraillent

Réagir face aux erreurs 404

Chaque page 404 laisse filer des liens, détériore l’expérience utilisateur, et gaspille la valeur du SEO construite avec le temps. Pour y remédier, adoptez ce réflexe :

- Redirection permanente (301) vers une page voisine pertinente

- Redirection temporaire (302), utile principalement en phase de test

Des plugins sont disponibles sur WordPress pour gérer cela, comme Redirection ou Yoast SEO Premium. Évitez la redirection vers la page d’accueil si le contenu supprimé possède un équivalent ou un sujet similaire.

Attention à la balise NoIndex

La balise « noindex » empêche Google d’indexer certaines pages. On l’utilise souvent pour les pages de remerciement, zones membres ou mentions légales, mais il suffit d’un réglage mal positionné pour bloquer une page stratégique. Sur WordPress, Yoast SEO ou All in One SEO Pack permettent de définir le champ d’indexation page par page.

Vérifier sitemap.xml et robots.txt

Le sitemap recense toutes les urls importantes de votre site, mentionnant leur date de mise à jour, souvent généré automatiquement par un plugin SEO. Déclarez-le dans la Search Console pour valider son bon usage. Quant au fichier robots.txt, il dicte aux moteurs le périmètre de leur exploration. Depuis 2019, la mention “noindex” dans robots.txt n’est plus prise en compte : préférez les balises HTML.

Étape 4 : agir sur les recommandations des outils SEO

C’est là que la liste des axes de correction s’étoffe. Les outils professionnels affichent en priorité les problèmes critiques et détaillent leur impact, souvent avec un lien “éclaircissement” ou “remédiation” à côté de chaque problème remonté.

Les points qui demandent une intervention rapide

Insistez immédiatement sur :

- Un unique titre H1 bien choisi par page

- Des meta-titres et descriptions propres à chaque URL, sans répétition

- Suppression ou signalétique claire des contenus dupliqués (balise canonique ou noindex selon les cas)

- Vérification de la rapidité de chargement des pages (cf. étape suivante)

- Fonctionnement de tous les liens internes et externes

- Gestion systématique des erreurs 404

- Explorabilité de l’ensemble des URLs importantes

- Navigation sécurisée exclusivement sous HTTPS

Ajoutez aussi :

- Images exemptes d’erreurs et disposant systématiquement d’un attribut alt descriptif

- Sitemap XML valide et bien référencé

- Fichier robots.txt correct, sans excès de consignes

- Plan du site mentionné dans robots.txt

- Balise hreflang renseignée sur les sites multilingues

- Certificat SSL global

- Suppression des chaînes de redirections inutiles

- Compression des fichiers Javascript/CSS et cache serveur actif

Les axes à surveiller de près

Certains défauts gênent la qualité perçue plus que le positionnement pur. Examinez notamment :

- Ratio texte/code HTML supérieur à 10%

- Pages sous les 300 mots, souvent synonymes de contenu trop bref

- Longueur des meta-titres (moins de 70 caractères) et descriptions (moins de 160 caractères)

- Images systématiquement légendées (attribut alt)

- Usage de 301 à la place des redirections temporaires

- Tirets dans les urls (éviter les underscores)

- Liens internes paramétrés en dofollow

- Implémentation d’outils modernes (compression, mise en cache, WebP, etc.)

- Urls concises, débarrassées de toute lourdeur

Des pistes d’amélioration supplémentaires

Même en dehors des urgences, certains choix techniques ou structurels valent d’être anticipés :

- Raccourcir le nombre de clics nécessaires pour accéder aux pages clés

- Mailler entre elles les pages stratégiques du site

- Placer avec discernement les balises noindex ou nofollow

Étape 5 : accélérer le chargement du site

La rapidité est désormais scrutée par Google et décisive pour chaque utilisateur. Il existe aujourd’hui une ribambelle d’outils pour tester la performance sur ordinateur comme sur mobile, à commencer par Google PageSpeed Insights, Test My Site with Google, Pingdom, Gtmetrix ou Experte.de. Un résultat médiocre impose d’agir vite.

Avec un hébergement réellement optimisé pour WordPress, les temps de réponse raccourcissent d’eux-mêmes grâce au cache et à la configuration serveur. Sur un hébergement classique, ou si votre site reste lent malgré tout, installez un plugin comme WP Rocket pour épauler le serveur dans son rôle.

Dans le détail, assurez-vous que :

- L’hébergement ne tire pas vers le bas la performance

- La mise en cache et la compression sont correctement activées

- Tous les liens du site affichent les pages rapidement

- Un CDN adapté est configuré avec discernement

- Les fichiers Javascript, animations et autres ressources lourdes sont limités

- Le chargement différé est activé pour les images (lazy loading)

- Les images sont compressées et publiées dans un format moderne

- Les métadonnées inutiles ont été supprimées des médias

- Les PDF publics sont compressés avant mise en ligne

- Les images sont à la bonne dimension dès l’upload

- Les intégrations externes (polices, réseaux sociaux, vidéos…) sont limitées au strict nécessaire

- Le site ne multiplie pas les plugins inutiles

- La base de données WordPress ou WooCommerce est nettoyée régulièrement

- Les chaînes de redirections sont supprimées pour éviter les délais d’affichage

Pour aller plus loin, des ressources spécialisées détaillent les meilleures techniques pour booster la vitesse de WordPress, absorber les pics de fréquentation ou miser sur un hébergement sur-mesure.

Étape 6 : inspecter les backlinks

La qualité et la nature des liens entrants restent fondatrices en référencement. Un unique bon backlink peut parfois peser lourd, mais à l’inverse, certains liens toxiques sont capables de mettre un site à genoux : achats sur des plateformes douteuses, spam, sites hackés ou domaines reconvertis en fermes à liens, rien n’est plus surveillé par Google.

J’ai croisé des cas de sites victimes de véritables attaques de liens, dégringolant du jour au lendemain à cause de milliers d’URLs toxiques. Si cela arrive, l’outil de désaveu de Google permet de faire le ménage. En quelques jours, l’impact négatif disparaît.

Voici la façon de s’y prendre efficacement :

Option manuelle avec Search Console

Dans l’onglet « Liens », exportez l’ensemble des domaines référents et vérifiez la pertinence de chaque source. Toute origine étrangère au sujet ou clairement suspecte doit être placée dans un fichier de désaveu, qu’on enverra à Google par le biais du service dédié.

Option automatisée via un outil SEO

Les plateformes comme Semrush ou Ahrefs proposent des audits de liens détaillés. Certaines, comme Ahrefs, référencent des millions de domaines et présentent directement la toxicité supposée de chaque lien associé à votre site. Les outils permettent de préparer facilement une liste de liens à désavouer, qui sera soumise à Google pour neutraliser leur influence négative. Précaution utile : connectez vos comptes Google pour obtenir une liste exhaustive des backlinks.

Pendant l’analyse, posez-vous systématiquement deux questions :

- Ce site référent a-t-il un rapport direct avec votre thématique ?

- S’agit-il d’un site à la réputation saine ? (évitez tout domaine signalé pour du contenu douteux, des arnaques ou du piratage)

Regardez aussi où pointent les liens et sur quels textes

Examinez grâce à la Search Console quelles pages reçoivent le plus de liens et quels mots ou expressions servent d’ancrage. Un profil de liens centré à 100% sur la page d’accueil ou trop homogène dans ses textes d’ancrage dramatise le risque d’être suspecté de manipulation. Il vaut mieux avoir des liens répartis entre différentes pages stratégiques, avec des ancres aussi variées et naturelles que possible.

Étape 7 : suivre les positions et le trafic organique

L’objectif final d’un audit SEO, c’est d’activer le trafic réellement en provenance de Google, Bing et consorts. Pour monitorer vos résultats, ouvrez Google Analytics, rendez-vous dans Audience > Vue d’ensemble, puis filtrez sur le trafic organique et observez la tendance des 12 derniers mois.

En cas de pic ou de chute brutale, vérifiez s’il existe une corrélation avec une mise à jour de l’algorithme des moteurs. De nombreux outils d’analyse affichent le calendrier des grandes mises à jour pour comprendre l’origine des variations. Pour connaître en détail vos positions, des solutions spécialisées révèlent les requêtes qui génèrent le plus d’affichages, la progression ou la perte sur chaque mot clé ciblé.

Quand la courbe s’enlise, étudiez la concurrence sur vos requêtes principales et rafraîchissez sans tarder vos contenus. Souvent, une simple révision ciblée fait toute la différence. Si aucune mise à jour Google n’a d’effet, regardez du côté de vos propres changements : un mauvais plugin, une page stratégiquement modifiée ou supprimée peuvent expliquer le décrochage. Procédez par élimination pour remonter la source du problème.

Étape 8 : revisiter contenu et qualité éditoriale

Les moteurs privilégient les contenus régulièrement remis à jour et vraiment utiles. Satisfaire à ces exigences, c’est entretenir à la fois la fidélité des internautes et les positions acquises au fil du temps. Lors d’un audit de contenu, examinez chaque URL et posez-vous de vraies questions :

- Y a-t-il une vraie valeur ajoutée pour le visiteur ?

- Le contenu est-il actualisé ?

- Des doublons existent-ils ? Certains contenus mériteraient-ils d’être fusionnés ?

- Cette page favorise-t-elle l’expérience utilisateur ou la dégrade-t-elle ?

La démarche la plus efficace : créer un tableau listant toutes les pages, décider pour chacune si elle doit être supprimée, fusionnée, réécrite, ou laissée telle quelle. Croisez ensuite ces arbitrages avec les durées de session et taux de rebond (rubrique comportement dans Google Analytics) pour appuyer vos choix.

Si besoin, inspirez-vous de méthodes détaillées dans certains articles ou ouvrages spécialisés sur l’audit de contenu : ils décryptent pas à pas des stratégies de remise à plat efficaces.

Un rappel sur les balises méta

Trop de sites négligent la réécriture des meta-titres ou descriptions lors du diagnostic éditorial. Pourtant, ces courts textes affichés par Google font souvent la différence dans le taux de clics. Pour les évaluer, tapez la commande « site:votredomaine.fr » dans Google puis analysez la longueur, l’originalité et l’attractivité de ces balises. Ni trop longues, ni trop ternes, ni absentes : adaptez-les page à page pour booster votre visibilité.

De nombreux plugins SEO permettent la modification à la volée de ces balises dans WordPress, avec alerte pour éviter toute surcharge ou manque de pertinence.

Dernier mot

Un audit SEO déblaie bien plus qu’un simple état des lieux : il remue des couches inattendues, révèle les faiblesses imprévues, et éclaire de nouvelles marges de manœuvre. Les actions à mener ne s’épuisent jamais. Lire entre les lignes, sentir les signaux faibles, avancer avec audace : voilà la vraie dynamique du référencement. Les algorithmes changent, la curiosité reste la meilleure arme. Ceux qui sauront prendre les devants bâtiront le web qui compte demain.